On sait maintenant que l'IA pulvérise l'homme dans tous les jeux d'intelligence traditionnels.

Terrence Sejnowski est un célèbre neurobiologiste, professeur au Salk Institute à La Jolla (Californie - USA). Il est également référent du Howard Hughes Medical Institute de Chevy Chase (Maryland, USA). A partir d'une représentation 3D du tissu de l’hippocampe, l'équipe de Sejnowski a découvert quelques résultats surprenants, publiés dans la revue en ligne eLife (ici).

L'analyse de tissus cérébraux de rats a permis de reproduire en 3D quelques micromètres de l'hippocampe dont on connaît le rôle fondamentale dans la mémoire. La reconstitution de la connectivité neuronale à ainsi pu être faite à un niveau nanomoléculaire par microscopie de pointe, et grâce à des algorithmes de calculs et d'imagerie sophistiqués. Les chercheurs ont été surpris de constater qu'il n'existe pas 3 catégories de synapses comme on le pensait auparavant, mais 26. En découle une aptitude de stockage complètement augmentée : 10 fois supérieure aux estimations précédentes. En effet, chaque neurone peut avoir des milliers de synapses, le connectant à de milliers d'autres cellules.

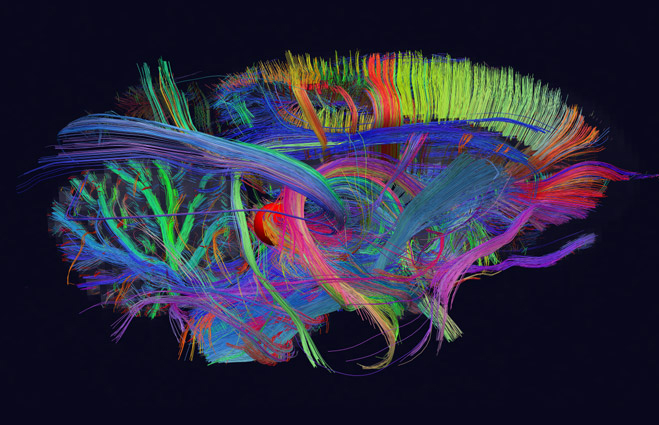

|

| Connectomes cérébraux |

Ramené au cortex cérébral et au nombre approximatif de synapses, les travaux de l'équipe de Sejnowsky (résumé) suggèrent que l'homme disposerait d'une capacité d'au moins un pétaoctet (10 puissance 15) de bits tout en ne consommant qu'une énergie ridiculement faible (moins qu'une simple ampoule basse consommation de 20W) par rapport à toute machine de calcul envisageable. Cela expliquerait pourquoi le cerveau parvient à stocker autant d'informations, malgré si peu d’énergie, et a encore de beaux jours de supériorité à venir sur la machine et la puissance brute informatique.

Aucun commentaire:

Enregistrer un commentaire