Les applications d'IA envahissent le quotidien des hommes, que ce soit dans le domaine professionnel, le domaine de la vie privée, et même au delà, dans celui de l'intimité personnelle.

Le premier problème reste celui de la communication avec les outils de l'intelligence artificielle (UX), avant celui de la communication avec l'IA elle-même (KX) qui réserve de solides problématiques à la fois techniques et épistémologiques.

La DARPA a mis en œuvre un programme de recherche "CwC & XAI" qui aborde d'une part les dimensions UX du partage direct entre les personnes et les smart machines, et d'autre part qui valorise le partage de représentations propres à chaque catégorie de partenaires pour un partage en toute sécurité, robustesse et confiance. Ce programme est dirigé par David Gunning, à la fois expert en informatique et en psychologie.

UX : Communiquer avec les ordinateurs, ou la Communication with Computers (CwC).

Le domaine CwC dépasse le simple domaine des IHM (interfaces homme-machine), voire des IHS (intégration homme-système) de génération actuelle. Son ambition est de permettre une communication "symétrique" entre des personnes, expertes ou non, et les machines, dont les ordinateurs. La CwC est une forme d'IHS v2.0, pour laquelle les machines ne sont pas de simples récepteurs d'instructions ou émetteurs de réponses ou comportements préprogrammés, mais de véritables collaborateurs capables de recourir et d'utiliser des modes spontanés de communication. On pense évidemment au langage naturel, dans ses désinences verbales ou écrites, mais également aux gestes avec l'haptique, à la compréhension des expressions faciales ou à celles des caractéristiques du regard ou de la motricité oculaire ...

La communication est ici comprise comme le partage de contenus cognitifs, représentations ou idées complexes mobilisées dans des contextes de collaboration. De telles idées complexes sont supposées être construites à partir de prototypes cognitifs variant de manière à être adaptés à chaque situation inattendue, non programmée, dans un registre ouvert de connaissances qui s'auto-enrichissent les unes les autres en fonction de l'expérience. C'est ainsi qu'à partir d'un nombre limité d'exemplaires représentationnels de départ, et notamment grâce aux caractéristiques d'un langage ouvert faisant place à l'analyse stochastique des ambiguïtés, peuvent émerger, se construire et se stabiliser des idées de plus en plus complexes.

Le recours à cette production émergente laisse une large part aux théories de la complexité et à celle de l'émergence, pour déboucher sur une forme d'intelligence artificielle capable d'exprimer des idées sur elle-même, c'est-à-dire de s'expliquer elle-même, d'expliquer ses "raisonnements", "représentations" et "décisions" à autrui, que celui-là soit humain ou machinique.

KX : la partage des connaissances ou l'Intelligence artificielle explicable (XAI).

Les succès des apprentissage par machine, apprentissage profond, décision automatique ... amène à un développement, au delà des interfaces CwC, à des applications d'intelligence artificielle (IA) de plus en plus rapide, robustes et autonomes. Ces systèmes sont capables de sentir, percevoir (c'est-à-dire associer des sensations à des représentations internes), se représenter (tenir des inventaires de correspondances congruents entre les éléments et situations réels et ceux représentés au sein des machines comme chez les personnes humaines. Ces apprentissages s'inscrivent dans des activités mnémoniques pour lesquelles les différents registres qualitatifs de mémoires rencontrent les masses de données qui peuvent être traitées dans le cadre du Big Data. Dans ce contexte, les machines sont capables de très rapidement et avec un taux d'erreur très faible de décider et le cas échéant d'agir dans des délais proches de l'immédiateté.

Ces dépassements des simples capacités humaines engendrent la création de machines autonomes, dont le contrôle éventuel ne peut être fait qu'à postériori, dans des temps compatibles avec ceux de la lenteur de l'appareil serveur et/ou cognitif humain.

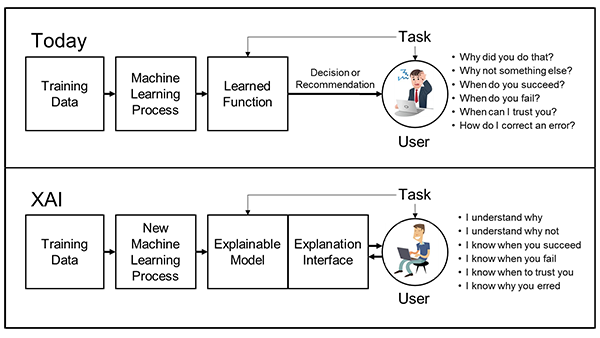

C'est là que se pose le problème du blocage de l'efficacité des systèmes par l'impossibilité que l'homme a de faire confiance à la machine. On connait ce type de situation dans le domaine du véhicule autonome et encore plus dans celui des SALA (systèmes d'armes létales autonomes) avec lesquels le respect de la vie humaine peut être engagé. La seule solution est une forme d'apprentissage collaboratif, partenarial, de l'homme et de la machine, dans laquelle la machine est capable d'expliquer à l'homme le sens de ses décision et les limites de son autonomie ; ce que ne savent pas faire les machines actuelles.

De tels systèmes symbiotiques (HAT pour Human-Autonomy Teaming) nécessitent une Intelligence Artificielle capable de s'expliquer, et donc "explicable". C'est tout l'enjeu de la "confiance" dans les machines décisionnelles ou de contrôle, dans un projet global d'intégration bidirectionnelle des hommes et des machines, de type XAI.

Aucun commentaire:

Enregistrer un commentaire